Leia em 3 minutos.

Este texto foi lambido por 129 almas essa semana.

traduzido por Kaio Shimanski do Centro Pineal

E se uma IA pudesse interpretar sua imaginação, transformando imagens em sua mente em realidade? Embora isso pareça um detalhe em um romance cyberpunk, os pesquisadores agora conseguiram exatamente isso, de acordo com um artigo publicado recentemente.

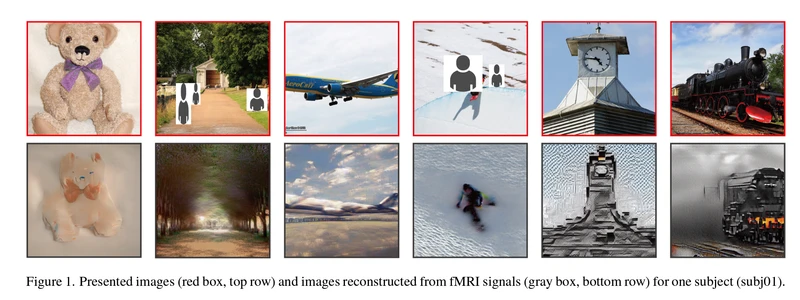

Os pesquisadores descobriram que podiam reconstruir imagens de alta resolução e altamente precisas da atividade cerebral usando o popular modelo de geração de imagens Stable Diffusion, conforme descrito em um artigo publicado em dezembro. Os autores escreveram que, ao contrário dos estudos anteriores, eles não precisaram treinar ou ajustar os modelos de IA para criar essas imagens.

Os pesquisadores – da Graduate School of Frontier Biosciences da Universidade de Osaka – disseram que primeiro previram uma representação latente, que é um modelo dos dados da imagem, a partir de sinais de fMRI. Em seguida, o modelo foi processado e ruído foi adicionado a ele por meio do processo de difusão. Finalmente, os pesquisadores decodificaram representações de texto de sinais de fMRI dentro do córtex visual superior e as usaram como entrada para produzir uma imagem final construída.

Os pesquisadores escreveram que alguns estudos produziram reconstruções de imagens de alta resolução, mas somente após o treinamento e o ajuste fino dos modelos generativos. Isso resultou em limitações porque o treinamento de modelos complexos é desafiador e não há muitas amostras em neurociência para trabalhar. Antes deste novo estudo, nenhum outro pesquisador havia tentado usar modelos de difusão para reconstrução visual.

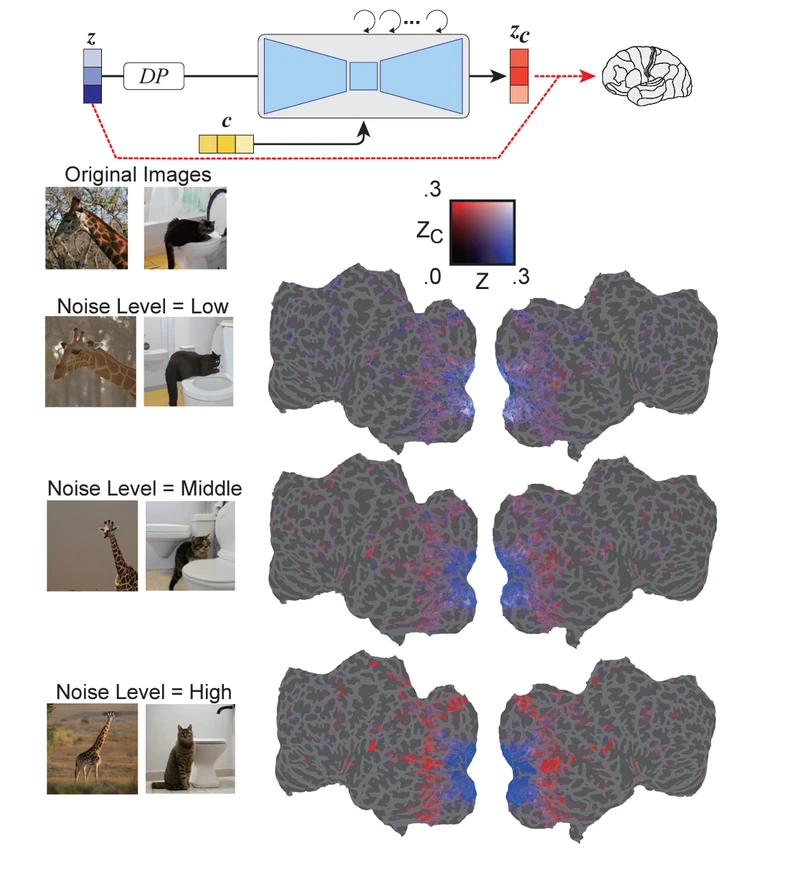

Este estudo foi uma espiada nos processos internos dos modelos de difusão, concluíram os pesquisadores, dizendo que o estudo foi o primeiro a fornecer uma interpretação quantitativa do modelo de uma perspectiva biológica. Por exemplo, existe um diagrama que os pesquisadores criaram mostrando a correlação entre os estímulos e os níveis de ruído no cérebro. Quanto mais alto o nível dos estímulos, mais alto seria o nível de ruído e maior seria a resolução da imagem. Em outro diagrama, os pesquisadores mostram o envolvimento de diferentes redes neurais no cérebro e como reduziria o ruído de uma imagem para reconstruí-la.

“Esses resultados sugerem que, no início do processo de difusão reversa, as informações da imagem são comprimidas dentro da camada de gargalo. À medida que o denoising progride, uma dissociação funcional entre as camadas U-Net emerge dentro do córtex visual: ou seja, a primeira camada tende a representar detalhes em escala fina em áreas visuais iniciais, enquanto a camada de gargalo corresponde a informações de ordem superior em áreas semânticas mais ventrais ”, escreveram os pesquisadores.

No passado, vimos outros exemplos de como as ondas cerebrais e as funções cerebrais podem criar imagens. Em 2014, Jody Xiong, um artista de Xangai,usou biossensores EEG para conectar dezesseis pessoas com deficiência a balões de tinta. As pessoas então usariam seus pensamentos para estourar balões específicos e criar suas próprias pinturas. Em outro exemplo de EEG, a artista Lia Chavez criou uma instalação que permitia que os impulsos elétricos no cérebro criassem sons e obras de luz. O público usaria fones de ouvido EEG, que transfeririam os sinais para um sistema A/V, onde as ondas cerebrais seriam refletidas por meio de cores e sons.

Com o avanço da IA generativa, mais e mais pesquisadores têm testado as maneiras pelas quais os modelos de IA podem funcionar com o cérebro humano. Em um estudo de janeiro de 2022, pesquisadores da Radboud University, na Holanda, treinaram uma rede de IA generativa, uma predecessora da Stable Diffusion, em dados fMRI de 1.050 rostos únicos e converteram os resultados de imagens cerebrais em imagens reais. O estudo descobriu que a IA foi capaz de realizar uma reconstrução de estímulos incomparável. No último estudo divulgado em dezembro, os pesquisadores revelaram que os atuais modelos de difusão podem agora alcançar a reconstrução visual de alta resolução.

Traduzido do artigo original: https://www.vice.com/en/article/wxje8n/researchers-use-ai-to-generate-images-based-on-peoples-brain-activity